Vielleicht hat es der ein oder andere bereits mitbekommen, ich halte mich gern unnötig lange mit einzelnen Themen auf.

Ich hätte auch gleich anders lösen können, aber ich wollte das es so fuktioniert wie in den Tutorials beschrieben. (IPSec | OSPF)

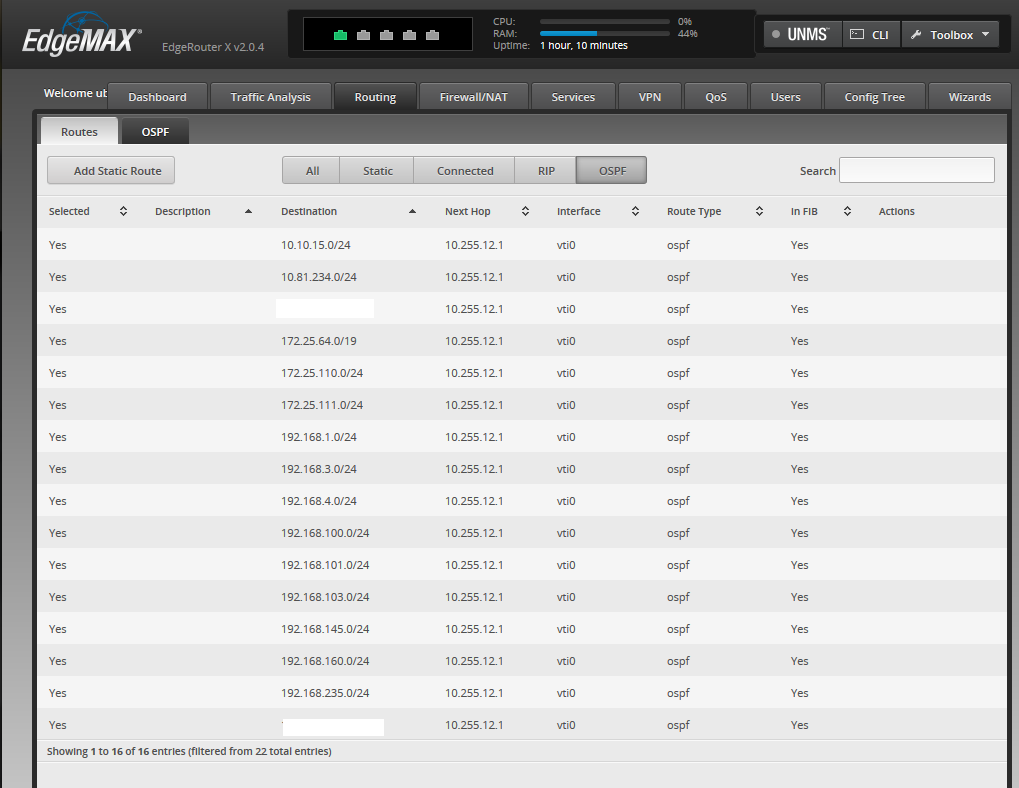

Kurz um, es geht um UBNT EdgeRouter und VPN/IPSec + OSPF.

Ich wollte von meiner Firewall im Lab OSPF -> Onside ER -> IPSec -> Home ER -> Wifi ER, aber ich dass mich irgendeine Inompatibilität oder so gebissen hätte… nein, es war natürlich wieder IPSec – es ist schnell, aber ich hasse es bis es erstmal läuft.

Es ist auch erstmal alles nicht so schlimm, solange kein NAT/Port Forwarding und nur Public IP’s im Spiel sind.

Im großen und ganzen dachte ich mir so, „alles Anzünden & was mit Garten / Holzhütten machen“.

Symbolisch @DO9XE bei der Frage wie das denn mit dem WLAN auf der GPN18 war…

Da es absolut nich wollte, habe ich dann einen 1:1 Nachbau des Tutorial Setups bei mir auf dem Tisch hingestellt (von oben):

1. ER-R

2. ER-L

3. „Internetwolke“

4. Weiterer OSPF Router

5. Switch zum Lab

Config ER-R

VPN

configure

set vpn ipsec auto-firewall-nat-exclude enable

set vpn ipsec ike-group FOO0 lifetime 28800

set vpn ipsec ike-group FOO0 proposal 1 dh-group 14

set vpn ipsec ike-group FOO0 proposal 1 encryption aes128

set vpn ipsec ike-group FOO0 proposal 1 hash sha1

set vpn ipsec esp-group FOO0 lifetime 3600

set vpn ipsec esp-group FOO0 pfs enable

set vpn ipsec esp-group FOO0 proposal 1 encryption aes128

set vpn ipsec esp-group FOO0 proposal 1 hash sha1

set vpn ipsec site-to-site peer 203.0.113.1 authentication mode pre-shared-secret

set vpn ipsec site-to-site peer 203.0.113.1 authentication pre-shared-secret 1234

set vpn ipsec site-to-site peer 203.0.113.1 description ipsec

set vpn ipsec site-to-site peer 203.0.113.1 local-address 192.0.2.1

set vpn ipsec site-to-site peer 203.0.113.1 ike-group FOO0

set vpn ipsec site-to-site peer 203.0.113.1 vti bind vti0

set vpn ipsec site-to-site peer 203.0.113.1 vti esp-group FOO0

set interfaces vti vti0 address 10.255.12.2/30

set protocols static interface-route 192.168.1.0/24 next-hop-interface vti0

commit ; save

OSPF

configure

set interfaces vti vti0 ip ospf network point-to-point

set protocols ospf parameters router-id 172.16.1.1

set protocols ospf area 0.0.0.0 network 10.255.12.0/30

set protocols ospf area 0.0.0.0 network 172.16.1.0/24

commit ; save

Config ER-L

VPN

configure

set vpn ipsec auto-firewall-nat-exclude enable

set vpn ipsec ike-group FOO0 lifetime 28800

set vpn ipsec ike-group FOO0 proposal 1 dh-group 14

set vpn ipsec ike-group FOO0 proposal 1 encryption aes128

set vpn ipsec ike-group FOO0 proposal 1 hash sha1

set vpn ipsec esp-group FOO0 lifetime 3600

set vpn ipsec esp-group FOO0 pfs enable

set vpn ipsec esp-group FOO0 proposal 1 encryption aes128

set vpn ipsec esp-group FOO0 proposal 1 hash sha1

set vpn ipsec site-to-site peer 192.0.2.1 authentication mode pre-shared-secret

set vpn ipsec site-to-site peer 192.0.2.1 authentication pre-shared-secret 1234

set vpn ipsec site-to-site peer 192.0.2.1 description ipsec

set vpn ipsec site-to-site peer 192.0.2.1 local-address 203.0.113.1

set vpn ipsec site-to-site peer 192.0.2.1 ike-group FOO0

set vpn ipsec site-to-site peer 192.0.2.1 vti bind vti0

set vpn ipsec site-to-site peer 192.0.2.1 vti esp-group FOO0

set interfaces vti vti0 address 10.255.12.1/30

set protocols static interface-route 172.16.1.0/24 next-hop-interface vti0

commit ; save

OSPF

configure

set interfaces vti vti0 ip ospf network point-to-point

set protocols ospf parameters router-id 192.168.1.1

set protocols ospf area 0.0.0.0 network 10.255.12.0/30

set protocols ospf area 0.0.0.0 network 192.168.1.0/24

commit ; save

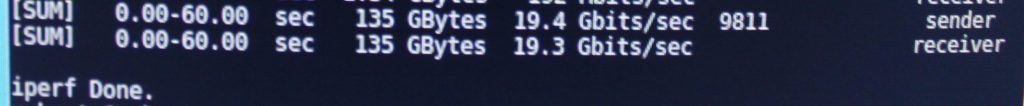

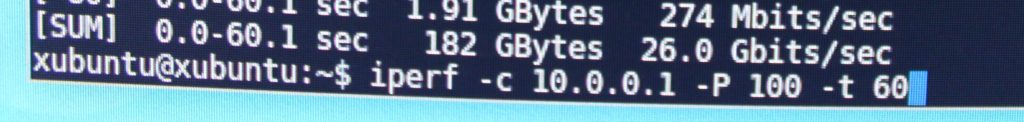

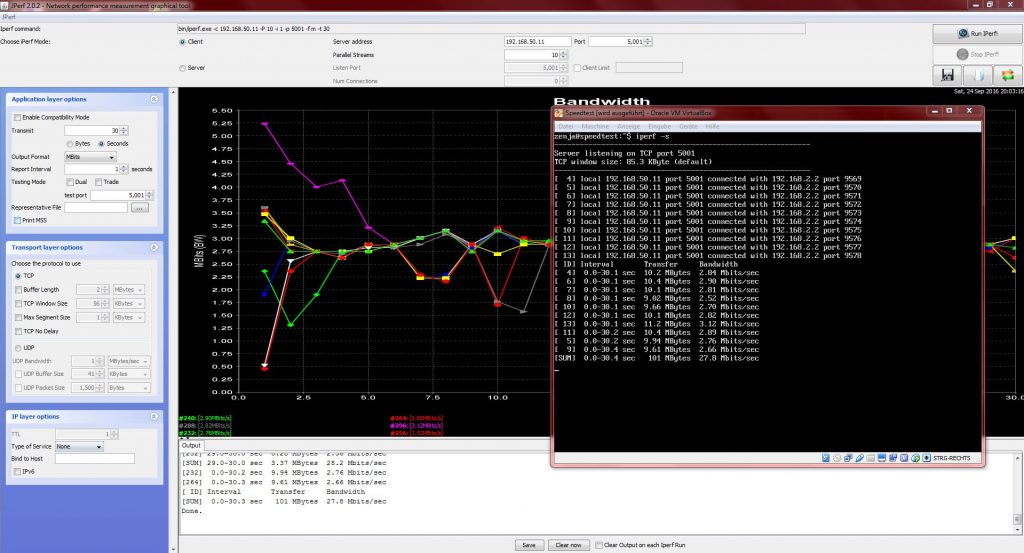

Schlussendlich hat wer 1:1 Aufbau auch funktioniert und die Performance mit Offloading ware auch ok.

Aber trozudem ließ es sich nicht in Prodution so umsetzen, da warum auch immer, IPSec bei mir zuhause einfach nicht will.

Daher habe ich mir dann kurzerhand die Anleitung geschnappt und das einfach nochmal mit OpenVPN ausprobiert.

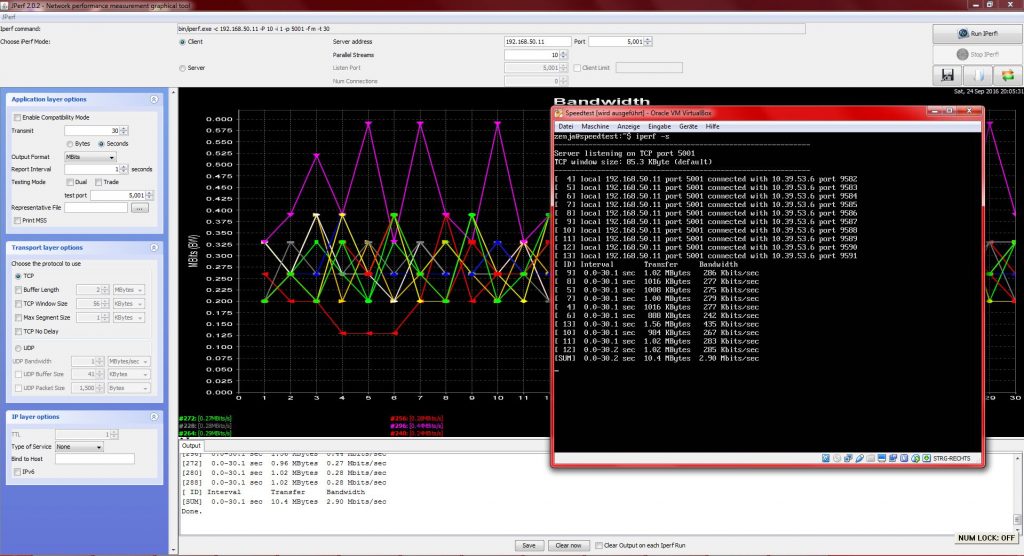

Ergebnis… geht, nicht schnell, aber geht und zwar Stabil und mit nur einem Public Port.

Falls jemand Ahnung hat, wie ich Tinc 1.1 auf den EdgeRouter bekomme, bitte gerne.

Ok, jetzt wird zuhause und ipsec will wieder nicht…

1:30h später…

Jetzt reichts, ich lass das jetzt mit dem IPSec, vielleicht tut ja openVPN auch…

5min später 13-15mbit und ospf so „ok, ich route dann mal“— zENjA / Jana (@nerdheimeu) July 11, 2019